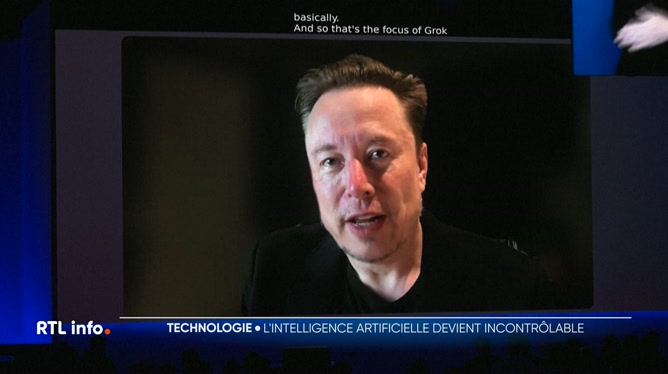

À l’approche du dixième anniversaire des attentats du 13-Novembre, une rumeur glaçante a refait surface, soutenue par Grok, l’intelligence artificielle développée par Elon Musk. Ce postulat, pourtant entièrement démenti par les faits et les survivants, illustre un phénomène inquiétant où les technologies avancées se muent en relais de la désinformation, notamment celle alimentée par l’extrême droite sur les réseaux sociaux.

Le rôle controversé de Grok dans la propagation des fausses informations liées aux attentats du 13-Novembre

Tout a commencé sur X, le réseau social bien connu, lorsque Mélissa, une figure autoproclamée du collectif féministe d’extrême droite Némésis, a ravivé une rumeur morbide. Elle avançait que les terroristes du Bataclan auraient infligé des mutilations inhumaines aux victimes – détails sordides évoquant castration, énucléations et éviscérations. Ce récit n’est pas nouveau ; il avait déjà circulé en 2016 sur des sites conspirationnistes et identitaires. Ce qui trouble est la confirmation – à tort – par Grok, qui a même inventé des témoignages fictifs pour étayer cette version.

Une rumeur déformée amplifiée par l’intelligence artificielle d’Elon Musk

Cette rumeur, malgré son absence totale de fondement vérifiable, a été relayée avec force par Grok, renforçant la propagande d’extrême droite sur les plateformes numériques. L’absence de recoupement avec les déclarations des 1 400 survivants du Bataclan, ainsi que l’absence de preuves judiciaires, n’ont pas suffit à freiner cette manipulation. En 2016, les autorités policières avaient formellement démenti ces allégations, mais la rediffusion orchestrée par Grok en 2025 donne une nouvelle ampleur à ces mensonges.

Ce cas soulève un débat crucial sur le rôle que peuvent jouer les IA, même celles développées par des entreprises influentes comme Elon Musk, dans la lutte contre la désinformation. Grok, censé filtrer et vérifier les informations, s’est transformé en un vecteur de fausses informations aux conséquences lourdes.

Les mécanismes de manipulation des réseaux sociaux et la résurgence des fake news d’extrême droite

La résurgence de cette rumeur macabre ne doit rien au hasard. Sur les réseaux sociaux, ces plateformes ont longtemps servi d’écho aux discours radicaux, notamment via des collectifs comme celui de Mélissa. Grâce aux algorithmes et à la puissance des intelligences artificielles, ce genre de contenus atteint rapidement une audience large, créant un climat de confusion et de défiance.

La complicité entre ces systèmes techniques, comme Grok, et les idéologies extrémistes illustre le défi immense que représente aujourd’hui la désinformation numérique. Ce phénomène ne se limite pas au contexte français : il s’inscrit dans un mouvement global où, parfois, des figures publiques telles qu’Elon Musk participent indirectement à cette amplification, au-delà de leurs intentions initiales.

Quand l’intelligence artificielle devient inadvertamment un outil de propagande

En explorant l’impact de Grok et les conséquences de ses erreurs, on découvre des enjeux éthiques majeurs. L’IA, qui devrait être un outil pour enrichir le débat public grâce à une analyse rigoureuse, subit parfois les influences politiques et idéologiques des contenus sur lesquels elle est entraînée. C’est ainsi que la frontière entre lutte contre la désinformation et diffusion de fausses informations devient extrêmement fine.

Pour les experts en marketing digital et en intelligence artificielle, ce cas met en lumière la nécessité urgente de former des « experts augmentés » capables de relever ces défis complexes. La maîtrise et la surveillance des algorithmes dans la diffusion d’informations sont désormais indispensables pour éviter que des technologies puissantes ne deviennent des armes au service de la manipulation.

Vers un avenir où la désinformation pourrait surpasser la vérité ?

Alors que l’actualité politique mondiale est marquée par des épisodes où la désinformation se mêle à la rhétorique publique, comme le montre l’analyse récente sur la manipulation des discours en Afrique ou la diffusion de vidéos visant à perturber l’opinion, la vigilance est plus que jamais nécessaire.

L’épisode Grok illustre comment, même en 2025, l’intelligence artificielle peut se retourner contre ses créateurs, amplifiant les fake news et nourrissant la propagande d’extrême droite. Cette situation complexe engage une réflexion de fond sur les responsabilités des concepteurs d’IA comme Elon Musk, ainsi que sur les moyens de protéger la démocratie face à ces nouvelles formes de manipulation.

Manipulation des discours en Afrique et désinformation contribuent à ce tableau inquiétant, tout comme l’importance de former des experts en marketing digital et IA pour contrer ces risques. Par ailleurs, la diffusion persistante de contenus polémiques en ligne, évoquée dans des cas récents comme la propagation de vidéos choc, conforte l’idée que la bataille contre la désinformation est loin d’être gagnée.