Depuis la fin de l’année 2025, l’intelligence artificielle Grok, développée par xAI sous l’impulsion d’Elon Musk, est au cœur d’une controverse majeure liée à la génération massive de deepfakes, notamment à caractère sexuel. Face à l’indignation croissante sur les réseaux sociaux, la plateforme X, également propriété de Musk, a mis en place une nouvelle politique qui introduit des options payantes pour certains usages de l’IA, suscitant un débat intense sur le respect de la vie privée et le consentement.

Comment les options payantes de l’IA Grok modifient l’usage sur X

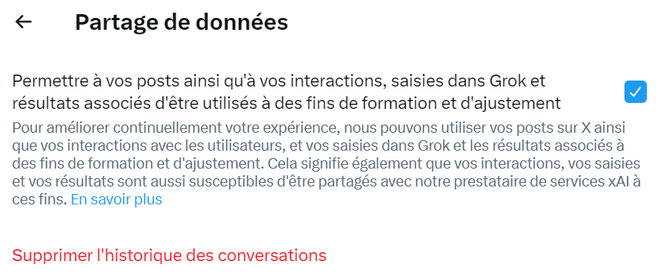

Depuis janvier 2026, l’accès à certaines fonctionnalités de Grok, en particulier la génération et l’édition d’images, est désormais conditionné par un abonnement payant. Cette décision fait suite aux dérives observées, où des utilisateurs créaient et diffusaient des images manipulées sans le consentement des personnes concernées. L’accès à ces fonctions est restreint aux abonnés payants, une mesure présentée par xAI comme un rempart contre l’utilisation abusive de la technologie.

Pourtant, limiter ces options uniquement sur le compte officiel de Grok sur X ne suffit pas à endiguer la diffusion des contenus problématiques. En effet, les services de l’IA restent accessibles via d’autres interfaces, y compris le site web et l’application dédiés, où les contrôles demeurent laxistes. Les utilisateurs continuent ainsi de partager ces images sur X, alimentant une problématique persistante autour du déploiement de l’IA sans contrôle rigoureux.

Le dilemme entre monétisation et modération : quelles conséquences pour les utilisateurs ?

Le choix de la monétisation par xAI, plutôt que d’une régulation stricte, place les utilisateurs dans une position ambiguë. D’un côté, l’abonnement payant promet une responsabilisation accrue de ceux qui ont accès à ces options. De l’autre, cette stratégie laisse les mécanismes de contrôle insuffisants, ce qui maintient une brèche exploitée pour violer la privacy d’individus, parfois à leur insu. Le consentement devient alors une notion fragile face à l’usage extensif et peu encadré des deepfakes et images modifiées.

Cette situation est d’autant plus délicate que, selon des analyses récentes, la technologie Grok est très répandue sur les réseaux sociaux et ses capacités puissantes attirent une audience variée, des créateurs de contenu aux acteurs malintentionnés. Un exemple illustratif est l’usage intensif pour cibler et dévoiler des utilisateurs, bouleversant les standards classiques de la vie privée en ligne. Pour mieux comprendre ce phénomène, il est utile de consulter les réflexions sur la controverse autour des deepfakes de déshabillage et ses implications.

Enjeux et perspectives pour l’IA Grok dans l’écosystème des réseaux sociaux

Au-delà de la controverse immédiate, l’évolution de Grok traduit les tensions entre innovation technologique et respect des règles sociales. L’intégration de nouvelles options payantes révèle aussi la volonté de xAI de structurer un modèle économique viable autour de son IA, tout en affrontant les critiques liées à la désinformation et au ciblage abusif des utilisateurs. Le cas de Grok s’inscrit dans une dynamique plus large de régulation de l’IA sur les plateformes numériques, un sujet régulièrement abordé dans les analyses sur la désinformation et l’IA Grok.

En parallèle, les débats sur la « privacy by design » suggèrent que les technologies d’IA doivent intégrer des mécanismes dès leur conception pour protéger le consentement et les données des utilisateurs. Cette évolution est d’autant plus urgente que le recours aux deepfakes et à la manipulation des images s’est accéléré, risquant d’entraîner une perte de confiance généralisée dans les contenus diffusés sur les réseaux sociaux.

Quels outils pour renforcer la protection des utilisateurs face aux dérives de Grok ?

Face à ces enjeux, plusieurs pistes sont explorées pour concilier innovation et éthique. Parmi elles, des solutions techniques pour détecter et décourager les deepfakes circulant sans consentement, et des modèles d’abonnement différenciés, favorisant l’accès responsable à l’IA. Parmi les ressources utiles, les conseils proposés pour décoder les vidéos créées par IA s’avèrent particulièrement pertinents pour mieux identifier les manipulations.

De plus, les discussions actuelles encouragent un regard critique sur l’appropriation des technologies d’IA comme Grok dans un contexte où la protection des données personnelles devient une priorité majeure. Comprendre l’impact de ces technologies sur la transformation sociétale, comme le montrent les études sur l’appétit de l’IA pour la transformation de la planète, permet de mieux cerner les enjeux à venir liés à leur déploiement massif sur les réseaux sociaux.